Microservicios de NVIDIA NIM

Diseñados para la implementación rápida y confiable de inferencia de IA generativa acelerada en cualquier lugar.

Descripción General

¿Qué Es NVIDIA NIM?

NVIDIA NIM™ proporciona microservicios de inferencia predesarrollados y optimizados para implementar rápidamente los modelos de IA más recientes en cualquier infraestructura acelerada por NVIDIA: la nube, el data center, las workstations y el edge.

Acelere la Implementación de IA con NVIDIA NIM

NVIDIA NIM combina la facilidad de uso y la simplicidad operativa de las API administradas con la flexibilidad y la seguridad de los modelos de autoalojamiento en su infraestructura preferida. Los microservicios NIM vienen con todo lo que los equipos de IA necesitan: los últimos modelos base de IA, motores de inferencia optimizados, API estándar de la industria y dependencias de tiempo de ejecución; preempaquetados en contenedores de software de nivel empresarial y listos para implementarlos y escalarlos en cualquier lugar.

Beneficios

IA Generativa Empresarial que Hace Más con Menos

Los microservicios sencillos y listos para la producción están desarrollados para la IA de alto desempeño y diseñados para trabajar sin problemas y escalar de manera asequible. Comience a desarrollar agentes de IA y otras aplicaciones de IA generativa empresarial más rápido con los últimos modelos de IA para razonamiento, simulación, habla y más.

Facilidad de Uso

Acelere la innovación y el tiempo de comercialización con microservicios predesarrollados y optimizados para los modelos de IA más recientes. Con las API estándar, los modelos se pueden implementar en cinco minutos y se los puede integrar fácilmente en las aplicaciones.

Nivel Empresarial

Implemente microservicios de nivel empresarial que NVIDIA administra continuamente a través de procesos rigurosos de validación y ramificaciones de funciones dedicadas, todo con el respaldo de la asistencia empresarial de NVIDIA, que también ofrece acceso directo a los expertos en IA de NVIDIA.

Desempeño y Escala

Mejore el costo total de propiedad con una inferencia de IA de baja latencia y alto desempeño que escala con la nube, y logre la mejor exactitud gracias a la compatibilidad con modelos de ajuste fino listos para usarse.

Portabilidad

Implemente en cualquier lugar con microservicios predesarrollados y nativos de la nube, listos para ejecutarse en cualquier infraestructura acelerada por NVIDIA (nube, data centers y workstations) y escale sin problemas en Kubernetes y en los entornos de proveedores de servicios en la nube.

Tecnología

Componentes de la IA Basada en Agentes

Análisis de Referencia

Impulse el Rendimiento con NIM

NVIDIA NIM proporciona una latencia y un rendimiento optimizados de inmediato para maximizar la generación de tókenes, admitir usuarios simultáneos en las horas pico y mejorar la capacidad de respuesta. Los microservicios NIM se actualizan continuamente con los motores de inferencia optimizados más recientes, lo que aumenta el desempeño de la misma infraestructura con el tiempo.

Configuración: Llama 3.1 8B instruct, 1 H100 SXM; solicitudes simultáneas: 200. NIM ACTIVADO: FP8, rendimiento de 1201 tókenes/s, ITL 32 ms. NIM DESACTIVADO: FP8, rendimiento de 613 tókenes/segundo, ITL 37 ms.

Modelos

Habilite Inferencia Empresarial para Miles de Modelos Abiertos

Implemente grandes modelos de lenguaje (LLM) compatibles con NVIDIA® TensorRT™-LLM, vLLM o SGLang para una inferencia de baja latencia y alto rendimiento en una infraestructura acelerada por NVIDIA.

Funciones

El Botón Fácil para el Desarrollo y la Implementación de IA

Los microservicios NIM, diseñados para ejecutarse en cualquier lugar, exponen las API estándar de la industria para una fácil integración con sistemas y aplicaciones empresariales, y escalan a la perfección en Kubernetes para ofrecer una inferencia de alto rendimiento y baja latencia a escala de nube.

Implemente NIM

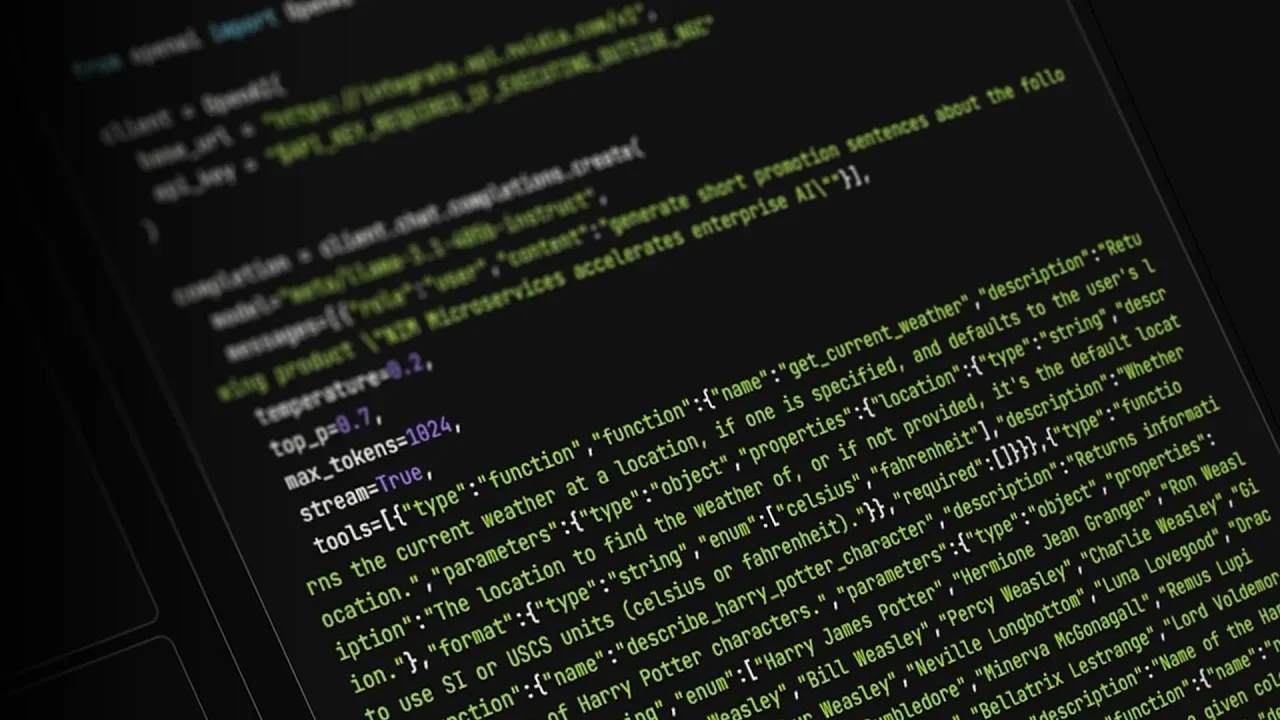

Implemente NIM en su modelo con un solo comando. También puede ejecutar fácilmente NIM con gramdes modelos de lenguaje (LLM) compatibles con NVIDIA TensorRT-LLM, vLLM o SGLang, incluidos los modelos perfeccionados.

Ejecute Inferencia

Comience a usar NIM con el motor de tiempo de ejecución óptimo basado en su infraestructura acelerada por NVIDIA.

Desarrolle

Integre terminales NIM autoalojados con tan solo unas pocas líneas de código.

Casos de Uso

Cómo se Está Usando NIM

Vea cómo la NVIDIA NIM respalda casos de uso de la industria y comience rápidamente su desarrollo de IA con ejemplos seleccionados.

-

Asistentes Virtuales de IA

-

Inteligencia en Documentos

-

Compras Hiperpersonalizadas

-

Configuradores de Productos 3D

Asistentes Virtuales de IA

Mejore la experiencia del cliente y los procesos empresariales con la IA generativa.

Procesamiento Inteligente de Documentos

Use la IA generativa para acelerar y automatizar el procesamiento de documentos.

IA para Compras Hiperpersonalizadas

Ofrezca experiencias personalizadas que mejoren la satisfacción del cliente con el poder de la IA.

Configuradores de Productos 3D

Use OpenUSD y la IA generativa para desarrollar e implementar herramientas y experiencias del configurador de productos 3D en casi cualquier dispositivo.

Opciones de Inicio

Maneras de empezar a usar NVIDIA NIM

Recursos

Los Recursos de NVIDIA NIM Más Recientes

-

Blogs

-

Sesiones

-

Cursos

-

Videos